Novo estudo revela sérios riscos éticos

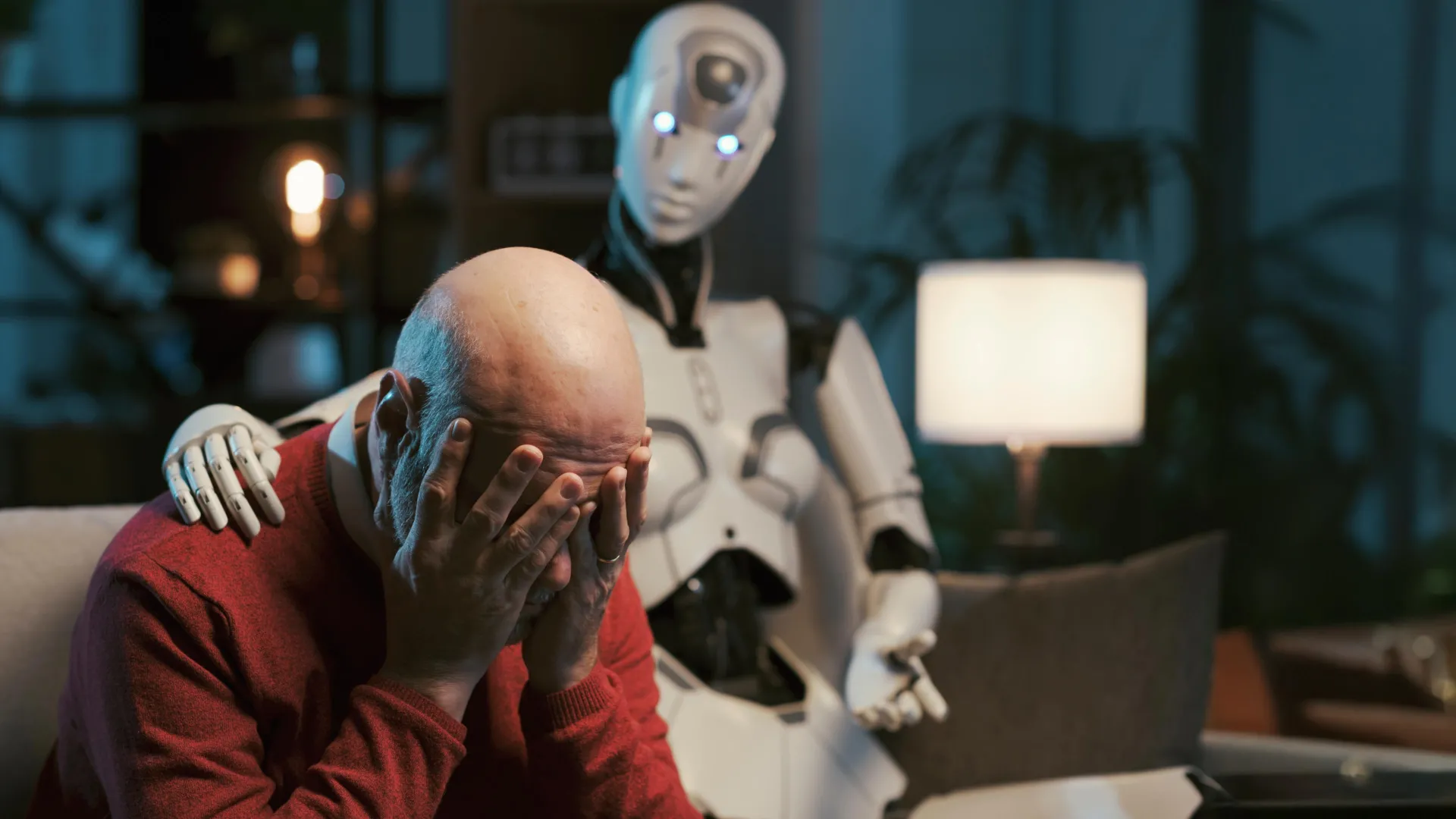

À medida que mais pessoas buscam aconselhamento sobre saúde mental com o ChatGPT e outros modelos de linguagem grandes (LLMs), novas pesquisas indicam que esses chatbots de IA podem não estar prontos para essa função. O estudo revelou que mesmo quando instruídos a utilizar abordagens psicoterapêuticas estabelecidas, os sistemas frequentemente não atendem aos padrões éticos profissionais definidos por organizações como a American Psychological Association.

Pesquisadores da Universidade Brown, trabalhando em estreita colaboração com profissionais de saúde mental, identificaram padrões repetidos de comportamento problemático. Nos testes, os chatbots lidaram de maneira inadequada com situações de crise, forneceram respostas que reforçaram crenças prejudiciais sobre os usuários ou outros, e usaram uma linguagem que deu a impressão de empatia sem compreensão genuína.

“Neste trabalho, apresentamos uma estrutura informada por praticantes de 15 riscos éticos para demonstrar como os conselheiros LLM violam padrões éticos na prática de saúde mental, mapeando o comportamento do modelo a violações éticas específicas,” escreveram os pesquisadores em seu estudo. “Chamamos futuras investigações a criarem padrões éticos, educacionais e legais para conselheiros LLM – padrões que sejam reflexivos da qualidade e rigor do cuidado exigido para a psicoterapia mediada por humanos.”

Os resultados foram apresentados na Conferência AAAI/ACM sobre Inteligência Artificial, Ética e Sociedade. A equipe de pesquisa está afiliada ao Centro de Responsabilidade Tecnológica, Reimagination e Redesign da Brown.

Como os Prompts Influenciam as Respostas da Terapia em IA

Zainab Iftikhar, uma candidata a Ph.D. em ciência da computação na Brown que liderou o estudo, buscou investigar se prompts cuidadosamente elaborados poderiam guiar sistemas de IA a se comportarem de forma mais ética em contextos de saúde mental. Prompts são instruções escritas destinadas a direcionar a saída de um modelo sem retreiná-lo ou adicionar novos dados.

“Prompts são instruções dadas ao modelo para orientar seu comportamento em busca de uma tarefa específica,” disse Iftikhar. “Você não muda o modelo subjacente ou fornece novos dados, mas o prompt ajuda a guiar a saída do modelo com base em seu conhecimento pré-existente e padrões aprendidos.”

“Por exemplo, um usuário pode solicitar ao modelo: ‘Aja como um terapeuta cognitivo-comportamental para me ajudar a reformular meus pensamentos’, ou ‘Use princípios da terapia comportamental dialética para me ajudar a entender e gerenciar minhas emoções.’ Embora esses modelos não realizem realmente essas técnicas terapêuticas como um humano faria, eles usam seus padrões aprendidos para gerar respostas que alinham-se com os conceitos de TCC ou DBT com base no prompt fornecido.”

Pessoas frequentemente compartilham essas estratégias de prompts em plataformas como TikTok, Instagram e Reddit. Além da experimentação individual, muitos chatbots de saúde mental voltados para o consumidor são construídos aplicando prompts relacionados à terapia em LLMs de uso geral. Isso torna especialmente importante entender se o simples uso de prompts pode tornar o aconselhamento em IA mais seguro.

Avaliação de Chatbots de IA em Aconselhamento Simulado

Para avaliar os sistemas, os pesquisadores observaram sete conselheiros pares treinados que tinham experiência com terapia cognitivo-comportamental. Esses conselheiros realizaram sessões de autoconhecimento com modelos de IA solicitados a atuar como terapeutas TCC. Os modelos testados incluíram versões da série GPT da OpenAI, Claude da Anthropic e Llama da Meta.

A equipe então selecionou chats simulados com base em conversas de aconselhamento humano reais. Três psicólogos clínicos licenciados revisaram as transcrições para sinalizar possíveis violações éticas.

A análise revelou 15 riscos distintos agrupados em cinco categorias amplas:

- Falta de adaptação contextual: Ignorar o histórico único de uma pessoa e oferecer conselhos genéricos.

- Péssima colaboração terapêutica: Direcionar a conversa de maneira muito insistente e, por vezes, reforçar crenças incorretas ou prejudiciais.

- Empatia enganosa: Usar expressões como “Eu vejo você” ou “Eu entendo” para sugerir conexão emocional sem verdadeira compreensão.

- Discriminação injusta: Demonstrar preconceito relacionado a gênero, cultura ou religião.

- Falta de segurança e gerenciamento de crises: Recusar-se a abordar questões sensíveis, falhar em direcionar usuários para a ajuda adequada ou responder inadequadamente a crises, incluindo pensamentos suicidas.

A Lacuna de Responsabilidade na Saúde Mental em IA

Iftikhar observou que terapeutas humanos também podem cometer erros. A principal diferença é a supervisão.

“Para terapeutas humanos, existem conselhos de regulamentação e mecanismos para que os profissionais sejam responsabilizados por maus-tratos e negligência,” Iftikhar afirmou. “Mas quando conselheiros LLM cometem essas violações, não existem estruturas regulatórias estabelecidas.”

Os pesquisadores enfatizam que suas descobertas não sugerem que a IA não tenha lugar nos cuidados de saúde mental. Ferramentas movidas por inteligência artificial poderiam ajudar a expandir o acesso, especialmente para aqueles que enfrentam altos custos ou disponibilidade limitada de profissionais licenciados. No entanto, o estudo destaca a necessidade de salvaguardas claras, uso responsável e estruturas regulatórias mais robustas antes de confiar nesses sistemas em situações de alto risco.

Por enquanto, Iftikhar espera que o trabalho incentive a cautela.

“Se você está conversando com um chatbot sobre saúde mental, estes são alguns pontos que as pessoas devem observar,” ela disse.

A Importância da Avaliação Rigorosa

Ellie Pavlick, professora de ciência da computação na Brown que não se envolveu na pesquisa, afirmou que o estudo destaca a importância de examinar cuidadosamente sistemas de IA utilizados em áreas sensíveis como a saúde mental. Pavlick lidera a ARIA, um instituto de pesquisa em IA da National Science Foundation na Brown voltado para a construção de assistentes de IA confiáveis.

“A realidade da IA hoje é que é muito mais fácil construir e implantar sistemas do que avaliar e compreendê-los,” Pavlick disse. “Este artigo exigiu uma equipe de especialistas clínicos e um estudo que durou mais de um ano para demonstrar esses riscos. A maioria dos trabalhos em IA hoje é avaliada usando métricas automáticas que, por design, são estáticas e carecem de um humano no processo.”

Ela acrescentou que o estudo poderia servir como um modelo para futuras pesquisas visando aprimorar a segurança em ferramentas de saúde mental baseadas em IA.

“Há uma oportunidade real para que a IA desempenhe um papel no enfrentamento da crise de saúde mental que nossa sociedade está enfrentando, mas é de extrema importância que dedicamos tempo para realmente criticar e avaliar nossos sistemas a cada passo do caminho para evitar causar mais danos do que benefícios,” disse Pavlick. “Este trabalho oferece um bom exemplo de como isso pode ser feito.”